La inteligencia artificial está elevando la desinformación a un nuevo nivel de sofisticación. Casos recientes, como la difusión de un falso golpe de Estado en Francia generado íntegramente con IA, evidencian cómo las fake news hiperrealistas pueden provocar confusión, impacto político y riesgos reales en cuestión de horas. En este artículo analizamos por qué este fenómeno representa una nueva amenaza y qué implicancias tiene para gobiernos, empresas y la seguridad digital.

La inteligencia artificial no solo está transformando la productividad y la innovación. También está redefiniendo la forma en que se construye y difunde la desinformación. El reciente caso del falso golpe de Estado en Francia, generado íntegramente con IA y difundido masivamente en redes sociales, es una señal clara de un nuevo tipo de riesgo: las fake news hiperrealistas con impacto político, social y estratégico.

Lo ocurrido no fue un simple montaje viral. Un video presentado como “noticia de última hora”, supuestamente emitido por un canal inexistente, mostraba escenas creíbles: patrullas policiales, un helicóptero sobrevolando París, soldados armados y una “periodista” relatando la destitución del presidente Emmanuel Macron. Todo era falso, pero el nivel de realismo fue suficiente para generar confusión, alarma internacional y millones de visualizaciones en pocos días.

El salto cualitativo de la desinformación con IA

Las noticias falsas no son nuevas. Lo que cambia radicalmente con la IA es su capacidad de simulación. Hoy, modelos generativos pueden crear videos, voces, imágenes y relatos que replican con alta precisión el lenguaje periodístico, los códigos visuales de los medios tradicionales y el comportamiento humano.

En este caso, el contenido fue lo suficientemente verosímil como para que incluso un jefe de Estado extranjero contactara directamente al presidente francés para preguntar qué estaba ocurriendo. Este detalle marca un punto de inflexión: la desinformación deja de ser solo un problema de reputación o redes sociales y pasa a convertirse en un riesgo geopolítico y de seguridad.

Plataformas, alcance y falta de control efectivo

Uno de los elementos más preocupantes del episodio fue la dificultad para retirar el contenido. A pesar de la denuncia directa del propio presidente, el video permaneció disponible durante días en la plataforma, acumulando más de 13 millones de visualizaciones, con apenas una advertencia genérica indicando que “podría haber sido creado o alterado digitalmente”.

Este hecho evidencia una brecha crítica entre la velocidad con que se produce y difunde la desinformación basada en IA, y la capacidad real de las plataformas para detectarla, evaluarla y contenerla oportunamente. La reciente decisión de reducir o eliminar mecanismos de verificación de datos solo profundiza esta asimetría.

Más allá de la política: impacto en empresas y organizaciones

Aunque este caso tuvo un foco político, el riesgo no se limita a los gobiernos. Las mismas técnicas pueden —y ya están siendo— utilizadas contra empresas, ejecutivos y marcas. Videos falsos anunciando quiebras, audios clonados solicitando transferencias urgentes, comunicados fraudulentos atribuidos a altos directivos o crisis reputacionales fabricadas desde cero son escenarios cada vez más plausibles.

La diferencia es que, con IA, estos ataques pueden escalar rápidamente, adaptarse al contexto local (idioma, acento, referencias culturales) y apuntar a audiencias específicas, aumentando su efectividad.

¿Por qué la IA potencia tanto las fake news?

Porque automatiza todo el ciclo:

- Producción masiva de contenidos falsos creíbles

- Personalización según país, industria o público objetivo

- Distribución optimizada en redes sociales

- Reducción de costos y barreras técnicas para los atacantes

En otras palabras, la desinformación deja de ser artesanal y pasa a ser industrial.

Prepararse para un escenario donde lo falso parece real

El caso francés demuestra que incluso actores con alto poder institucional no están completamente preparados para este tipo de amenazas. Para organizaciones públicas y privadas, esto refuerza la necesidad de ampliar la mirada sobre la ciberseguridad.

Ya no se trata solo de proteger sistemas y datos, sino también de:

- Validar la autenticidad de la información que circula

- Preparar protocolos de respuesta ante desinformación

- Capacitar a equipos para detectar señales de manipulación

- Integrar la gestión de reputación y comunicación de crisis al enfoque de seguridad

Nomani: la detección de ESET de deep fakes financieros

Los estafadores continúan perfeccionando el uso de deepfakes, emplean inteligencia artificial para generar nuevos sitios web de phishing y encuentran formas de mantenerse indetectables frente a las plataformas, los equipos de seguridad y los usuarios.

Si utilizaste redes sociales como Facebook, Instagram o Threads durante el segundo semestre de 2024, es muy probable que hayas visto anuncios fraudulentos que promovían falsas inversiones, productos milagrosos u otros tipos de estafas, amenazas que ESET detecta y bloquea bajo la firma HTML/Nomani.

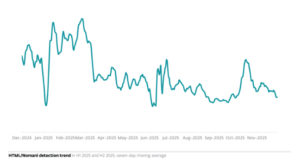

Un año más tarde, la telemetría de ESET muestra que esta actividad engañosa creció interanualmente en un 62%, alcanzando cientos de miles de detecciones a nivel mundial. Estas cifras se traducen en más de 64.000 URL únicas bloqueadas a lo largo de 2025.

Las campañas que difunden este tipo de contenido malicioso también se han extendido a otras plataformas de redes sociales, incluyendo YouTube. Como dato positivo, aunque las detecciones totales aumentaron en comparación con 2024, se observa una leve mejora: durante el segundo semestre de 2025 las detecciones disminuyeron un 37% respecto al primer semestre del mismo año.

Desde una perspectiva geográfica, la mayoría de las detecciones de HTML/Nomani en 2025 se originaron en República Checa, Japón, Eslovaquia, España y Polonia. Cabe señalar que muchos de estos países cuentan históricamente con una alta cobertura de productos de seguridad de ESET, lo que podría introducir cierto sesgo en las estadísticas.

El siguiente gráfico muestra la evolución de la detección de deep fakes por parte de ESET entre diciembre de 2024 y noviembre de 2025:

Considerando lo anterior, es altamente probable que la detección de esta familia continúe al alza durante 2026.

Un desafío que recién comienza

Las fake news generadas con IA no son un fenómeno aislado ni pasajero. Son parte de un nuevo ecosistema de amenazas donde la confianza, la percepción y la información se convierten en vectores de ataque.

El episodio del falso golpe de Estado en Francia es una advertencia clara: cuando la tecnología permite fabricar realidades alternativas creíbles, la seguridad deja de ser solo técnica y se vuelve profundamente estratégica. Anticiparse a este escenario será clave para proteger no solo infraestructuras, sino también la estabilidad, la reputación y la toma de decisiones.

En Lockbits creemos que entender este tipo de riesgos es el primer paso para enfrentarlos con criterio, preparación y una mirada integral de la seguridad digital. Si quieres estar al día de las nuevas problemáticas digitales, te invitamos a escribirnos en https://lockbits.cl/contacto/